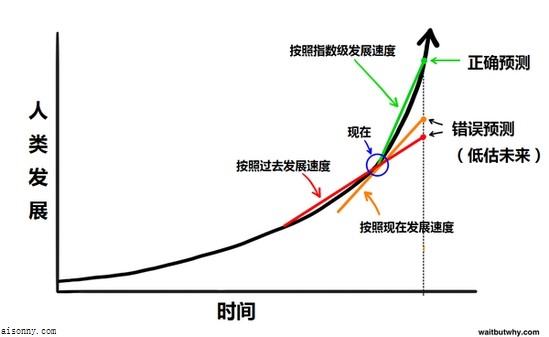

人工智能暢想曲谷歌的AlphaGo與代表人類的韓國圍棋冠軍李世乭的五番圍棋,把已經是相當熱鬧的人工智能問題,擺上了風口浪尖。隨着人類對電腦/人工智能的已經極度嚴重,還在與日俱增的依賴的發展,人工智能的安全性日益提上了嚴肅的人類議程。 【本文大部分內容不是本人獨創,而是從各種相關人工智能的書籍、文章中綜合而來。本文屬於科普性質,探討性質,不是學術論文,沒有那麼嚴肅。特此預先聲明。】 【第二個聲明是,這裡闡述的主要是對人工智能發展潛力最看好的一派人工智能專家的意見。很是駭世驚俗,說不好有多大可能成為現實。不是主流意見。先給你壓壓驚。】 【個人意見或用“筆者認為”打頭,或者放在【】中。】 一、若干相關定義智力(Intelligence):不同的人所各自擁有的不同於他人的理解複雜概念,有效地適應環境,通過經驗學習,進行不同類型的推理,通過思考去克服困難的能力。 人工智能(Artificial Intelligence, AI):。它是研究、開發用於模擬、延伸和擴展人的智能的理論、方法、技術及應用系統的一門新的技術科學。 人工智能分三個等級:弱人工智能(Weak AI)、強人工智能(Strong AI或 Artificial General Intelligence AGI通用人工智能)和超級人工智能(Super AI)。 弱人工智能就是在某一個方面可以媲美甚至超越人類能力的人工智能。其實這類人工智能的更準確叫法應該是專用人工智能(Special AI)。這樣的人工智能實在已經是太多。比如這次震撼地打敗李世乭的AlphaGo就是一個典型的弱(專用)人工智能。人類現在對這類弱人工智能的依賴已經是無所不在。離了這些弱人工智能,可以說,現代的人類社會一天也玩不下去。(當然那些原始部落除外。) 強人工智能就是不限於某一個具體行業,能在一般智力上媲美正常人類的人工智能。它的準確稱呼的確應當是通用人工智能。這個強(通用)人工智能就應當可以完成一個正常人所能做的所有(或大多數非特定的)智力活動。如果配上一個機器人的軀體,它也應當能夠(通常會更好地)完成人類所能從事的所有(或大多數非特定的)體力(物理)活動。 超級人工智能就是遠超最聰明的人類(比如愛因斯坦)的聰明程度的人工智能。它可能做的事情,在各種科幻電影中多有描述。大概在電影《終結者3》中描述的那個天網就是這種超級人工智能最可能的形態。這個超級人工智能一定是強人工智能自行發育然後覺醒(這個概念後面解釋)而成。從將來那時的現狀而言,它已經不能稱之為人工智能,雖然在淵源上它顯然來自人工智能。因此人們經常把術語中的人工一詞刪去,僅稱超級智能(Super Intelligence)。 這裡還要補充定義一下人工智能和機器人(Robot)的區別。機器人是一個有一定智能的軀體。(倒是不一定像人的形狀。人形機器人只是廣義機器人中的一類。)但人工智能則並不一定具有機器人的軀體。比如AlphaGo就沒有身體,它還需要台灣來的黃士傑博士幫它放棋子。人工智能的外延比機器人更廣,但人工智能是機器人的本質。 二、我們離強人工智能和超級智能還有多遠當代最著名的未來學家,Google公司的技術總監庫茲韋爾在2005年寫了一本十分著名的書名叫《奇點臨近》(The Syncularity is Near),提出一個發展速度的加速回報定律(law of acceleration return)。說的是,人類社會各方面,尤其是科學技術方面的發展速度在不斷加速。比如人類近500年來創造的物質精神財富超過以往10萬年。20世紀創造的人類文明成就超過以前20個世紀的總和。而21世紀以來的這15年,人類社會發生的變化,超過以前至少50年。而以後呢,從2015年到2030年的變化他認為鐵定比前15年快上至少一倍。以後類推,總之就是一個越來越陡的指數曲線。這樣推算下去,不用到本世紀末,地球人類的智慧產物,就可以鋪滿至少整個太陽系。(殖民、占領整個銀河系還是整個宇宙或者還要等到第22世紀?)

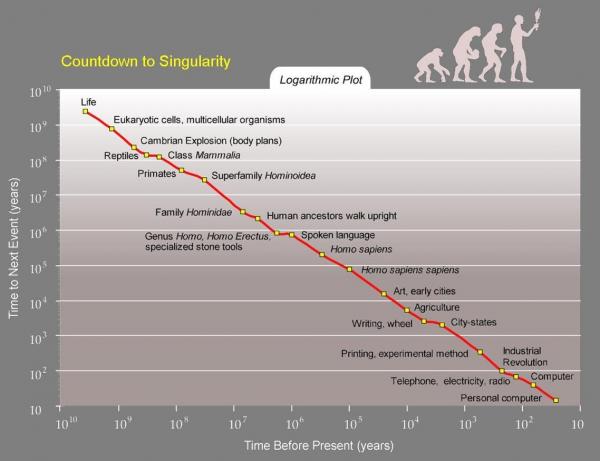

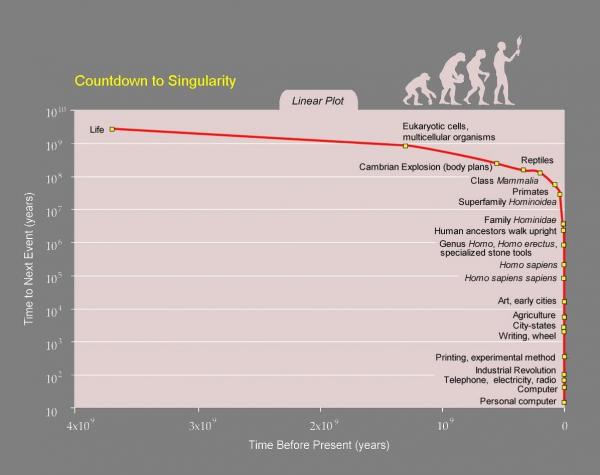

圖解:奇點的倒計時 橫軸是按指數排列的倒計時,單位是年。縱軸是按指數排列的地球史上重大事件之間的事件間隔,單位也是年。圖中是各項重大歷史事件。第一項是生命出現,最後一項是個人電腦出現。兩個軸都按指數排列後,重大歷史事件的位置連成一條十分平滑的斜線。 圖一到圖三,引自庫氏著作《奇點臨近》。 奇點倒計時2: 圖中數據與圖一完全相同。縱軸也相同,只是橫軸的標記改成了絕對時間線性排列。109是10億年。當然絕大多數重大事件都發生在最近。越近越密。就說越發展越快。 本人的確認為庫氏的估計過於樂觀,但人類科技在加速發展確是一個無可置疑的事實。比如IBM的深藍電腦在1997年戰勝人類國際象棋冠軍卡斯帕羅夫。那真是一台專用的電腦。完成下棋任務後根本沒有其它的用途,早就被拆掉。而現在深度思考公司開發的程序,在用來對付圍棋之前,已經有了很多用途,以後更是前途無量。他們開始研究圍棋不過兩年時間,半年以前,才是職業二段的水平,現在就可以打敗人類頂尖高手。再過幾個月,這個具體項目是不是只好停掉。因為那就像組成一個最強的地球足球隊,可它沒有對手(獨孤求敗)呀!或者,它可以來當人類棋手的教練,為古老的圍棋發展出一個機器流派。 人人都看得見,弱人工智能正在全面突破,一個接一個以前由人類壟斷的地盤被電腦/互聯網攻破然後逐步接管。(比如打字員、房屋中介、大量的實體商店……)人類現在幾乎所有的智能工作,都在電腦的協助下進行。離開了電腦,太多的智力行業(比如會計、建築設計師、媒體),已經完全玩不下去。現在甚至連編普通的應用程序都變得比以前簡單了許多。因為已經有了無計其數的現成的程序包。就像現成的樂高遊戲零件一樣,你只要按你的具體需要把它們拼接起來就行。比如你的程序要用到一個窗口,那個窗口已經現成,你只要把你需要的內容填進去就行,完全或用不着你再去編寫這個窗口的代碼了。

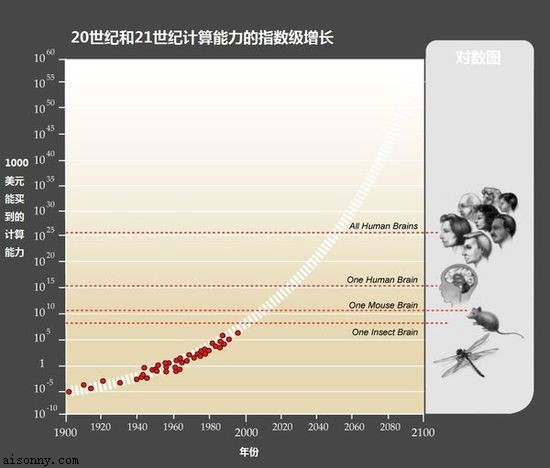

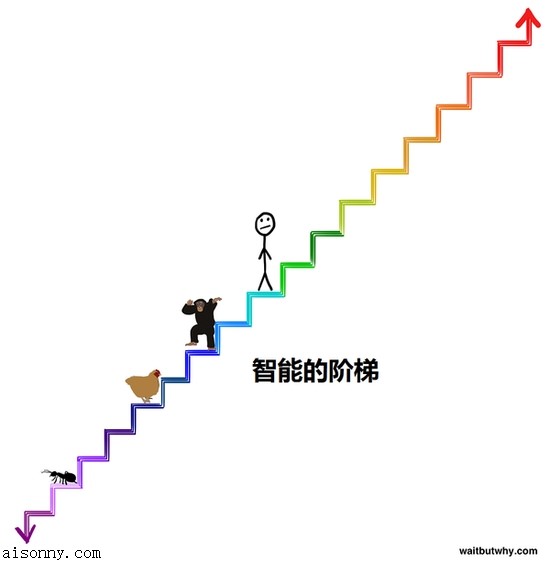

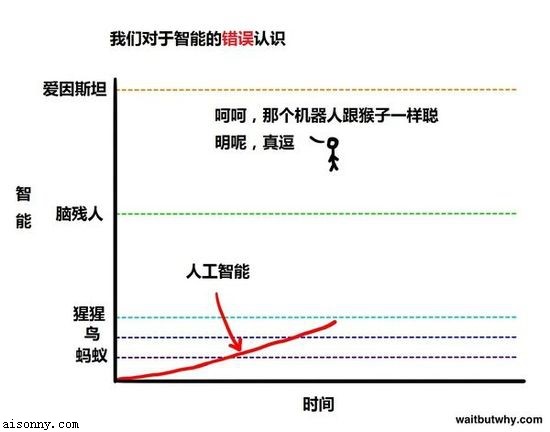

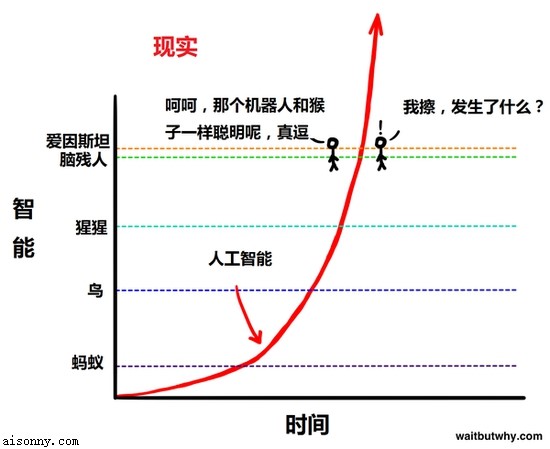

圖解:到2000年,1000美金能買到的電腦智力不及老鼠。今後按指數級數遞增,到2020年庫氏認為就可以接近人腦。到2050年1000美元就可以買到當今全人類的智力總和。這當然過於樂觀。竊以為,到那個時候,地球上的價值一定上億的最強大的電腦的能力,可以超過地球人智力的總和甚或許多還差不多。但絕不是一台1000美元的電腦就可以。那樣人真的是可以被徹底淘汰了 。 庫氏論證這個發展加速有極多繁複的論據。限於篇幅,我這裡只能是簡化再簡化。他的意思大體是說,在1950年代,電腦初生時代,其智力只能與變形蟲相當,到1960年代,與蟲子相當。到2000年代,與老鼠相當,到現代,已經與猿猴相當。想想地球上的生物從變形蟲發展到猿猴,可是用了幾十億年。從猿猴到人類則是上百萬年。而電腦從變形蟲水平發展到猿猴水平用了60年,那麼電腦猿猴水平再發展到電腦人的水平,還該用多少年呢?從現狀看,總而言之,幾十年應該是夠了。在人工智能專家群中做的民意測驗表明,最早的預計2025年,最遲的預計2060年,中位數是2045年,距今30年。庫氏把這個日期叫做人類技術發展的奇點,反覆告誡人們,在此日之後,人類的命運將與以前截然不同。【有人告訴我,這些參加測驗的專家,都是庫氏的朋友,見解有失偏頗,大家要保守看待這個估算。】

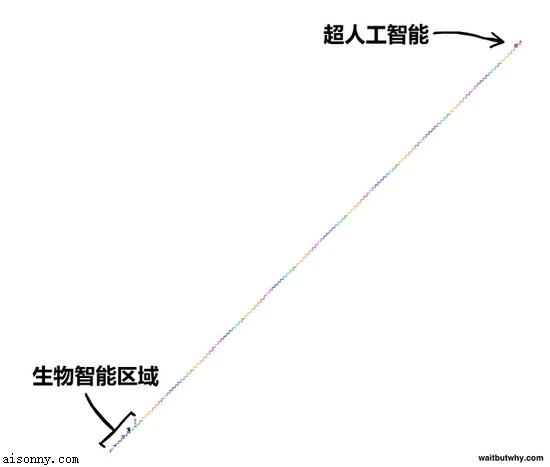

左圖表達的是對發展速度的不同估計。用那條發展速度指數曲線上切點的切線或割線的斜率表示。理解這一點需要高中解析幾何的數學基礎。大多數讀者應當還記得。 最可怕的不是這個30年的短暫跨度,而是這個30年以後,強人工智能並不會停止發展,而是遵循庫氏的那個加速回報定律,一定會在短短的幾年至多20年內,就發展到遠超人類智力水平的超級智能。未來學家把這個強人工智能出現到超級智能出現之間的狀況描述為:智力爆炸(Explosion of Intelligence)。這一派未來學家認為,在這個智力爆炸的過程中,困擾人類千年、萬年的絕大多數難題,都將得到解決。比如部分地區的物質匱乏,比如各種各樣的健康問題(所有的?疾病),比如最合理優秀的政治制度、世界政府。想想那時的人類有無數的超級愛因斯坦相助,這些問題解決起來,也應當是困難大減。 但真正可怕的是,在這個短短的看似極度美好的智力爆炸階段過去之後,第一個超級智能一旦出現,它有極大的可能在非常短的時間內就會通過互聯網接管其它所有的強人工智能。至於現在人類掌握的弱人工智能,就更不在話下。這第一台超級人工智能將擁有絕對的先發戰略優勢。而且這第一個超級人工智能好像非常可能是一個獨裁者,它不會對其它的強人工智能施行民主,即不會由它們選舉產生。 想想猿猴甚或螞蟻如何能夠理解人類在做什麼。數十年後,人類能否理解那個比全人類的智力加在一起還要強得多,而且還在繼續加速進化的超級智能在做什麼?想想看,這樣的前 景,是不是“細思恐極”?那一台超級人工智能控制了所有的強人工智能,人類還能幹什麼?

有人說,人類還有絕招,可以去拔電腦的電源插銷。有人具體建議李世乭把棋盤舉起來砸向AlphaGo的服務器。但是從視頻看,這台服務器顯然不在他們的對弈室里,那裡有的只是一個顯示屏。而那台服務器,至少在隔壁,更可能在雲里、在遠端。 將來哪一天,如果真有了超級智能,其硬件肯定分布在很多地方,其軟件肯定擁有許多的備份。它要是有了自主意識(稱“覺醒”),人類哪裡還會有機會和可能把它關掉。 這裡抄幾句那些未來學家的名言: “人工智能出現的意義,在地球的歷史上,只有人類的出現能與之相比擬。” “強人工智能將會是人類最後的一項發明創造。此後人類需要的一切都將由它代勞。” “未來屬於電腦,不需要我們。” “未來的人類可能就是人工智能豢養的寵物。” 【對這些名言的意涵,本人都持高度保留的態度。抄在這裡只是為了給大家醒醒神。】 三、人類生物智能和人工電子智能的強項與弱項先來說電子智能的強項: 電子智能的第一強項是它的速度遠高於人類,而且還在不斷地加速進化。比如據說AlphaGo 一天可以和自己下幾萬盤棋。而人的一生也不可能下那麼多盤。(可是這次實戰它思考的速度也不比人快呀?那它一天如何下幾萬盤呢?也許是故意藏拙吧?) 電子智能的第二強項是它的容量遠高於人類的大腦,而且也是在不斷地加速擴大。(比如AlphaGo的硬盤中,不知貯藏了多少人類高手和它自己下的棋局(據說3000萬局),而且它可以飛快並無誤地把它們找出來參考比對。人類棋手即使強如李世乭也不可能做到這一點。) 電子智能的第三強項是它們可以以人類無法比擬的速度聯合起來,互相複製,分享智慧和資訊。比起地球上的任何其它生物,人類已經創立了一個絕對無與倫比的聯合智慧,所以它才能成為地球的統治者。但是人類智慧的聯合程度,天然的就無法與電子智慧相比。 【比如,假設李世乭或柯潔誠心誠意地想把他們關於下圍棋的智慧分享給別人,這些人又需要多少時間,又有百分之多少能學得到九段水平?而 AlphaGo 如果樂意把它那可以打敗一切人類的圍棋技藝分享給其它的電腦,需要多少時間?有沒有數量的限制?是不是每一個下圍棋的人都可以通過互聯網得到一個九段的導師?同樣的道理, 如果人類造出了一個超級電腦醫生,通過若干年的深度學習,最後精通治療一切疾病,是不是可以輕易地把它複製十萬分,分派到世界的每一個角落?】 電腦的第四個強項是無論在硬件還是在軟件上,它都可以不斷地升級,複製,不會丟失,不會死亡。零件壞了,永遠可以替換。而人腦的內容則受限太多,在硬件上,根本就無法升級、擴展。在軟件上,轉移、保存、升級都要困難太多。 生物智能的硬件升級需要以萬年計算,軟件的大型升級(從1.0-2.0,能力增加至少一倍。)至少也需數十年。但電腦的軟硬件,平均兩年就可以升一級。電腦只要追近了人類,超過那就是一瞬間。一位很聰明的人形象地描述了這個狀況:“人工智能就像一列火車,它臨近時你聽到了轟隆隆的聲音,你在不斷期待着它的到來。他終於到了,一閃而過,隨後便遠遠地把你拋在身後。”

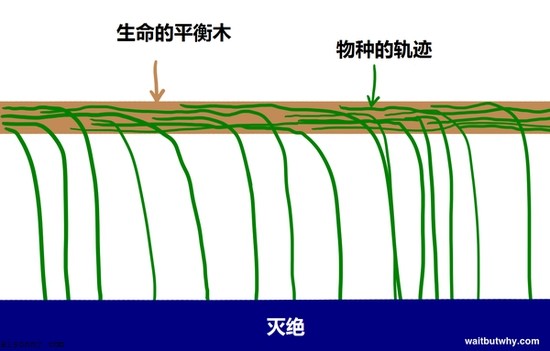

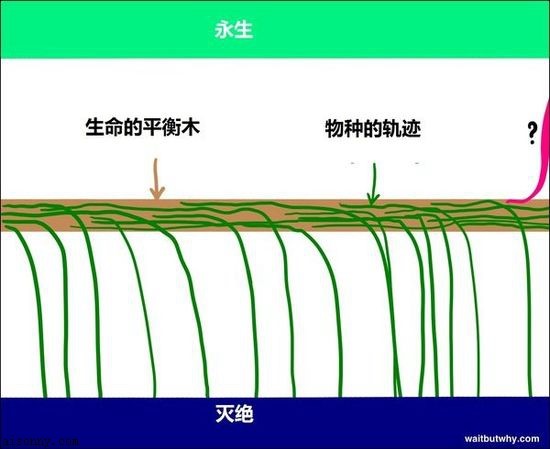

電腦的第五個優勢,就是它可以比人的五官有更多的傳感器。比如電眼可以看見紅外線紫外線、電耳可以聽見次聲波超聲波。電腦通過適當的天線還可以收集所有波長的無線電波、微波,而不是只有可見光,可聽聲。乃至引力波! 那麼說來,人類比起電腦來,就是一無是處羅?當然不是。現在來說人腦的長處: 先說與電腦有直接交集的純粹智力部分。電腦也有好些不及人腦的地方。電腦的優勢是規則越明確越好,信息越豐富越好。人腦則有能力去處理許多規則模糊的環境,依據不充足的信息去做出相對正確的決定。 比如指揮一場戰爭,對方一定會使出許多的隱藏甚至欺瞞的手段,資訊永遠不全甚至虛假。這時如何知己知彼,做戰略決斷,高明的軍事家就很可能比強大的電腦勝率更高。還有欺敵、設陷誘敵深入乃至故意輸陣在它方得利等手段,電腦恐怕都比不過人。【比如這回人機大戰,有段子手就編到:“我叫李世石,我是一名來自韓國的棋手,今天早上出門前我在網上各大投注點用盡家財下了巨額賭注買我自己輸。我想,這就是人類比人工智能強的地方。”當然我相信這不是真的,但實際戰術上卻是可行的。】 人類的直覺和靈感是電腦不會或很難有的。 這個直覺和靈感來源於常識、一個人的全部知識積累和說不清的靈光一閃。人類做決定一般不會離譜是因為每個人都有一整套他從生下來就開始的規則積累。如果他個人的規則積累不足,社會會補充提供。總之,他無法做出太離譜的決定(比如為了任何目的大規模殺人-恐怖分子除外)。西方的政治學不是講一個憲政嗎?人類社會真的是一個有着無數規矩的社會,最早的比如摩西的十誡,孔夫子的“己所不欲勿施於人”。現在則有無數的道德規範和強制性的法律。而電腦則沒有這個人人都有的一套常識,一套規矩。因此它一旦太強大,就會非常讓人不放心。 這裡已經涉及到了電腦的超強智力所不及的一個領域,就是道德。其實除了道德,電腦是弱項,人類是強項的智慧領域還有很多。比如情商、比如對美的鑑賞,音樂舞蹈文學藝術,喜怒哀樂、自我犧牲、對崇高、偉大的崇敬等等等等。人類社會賴以發展到今天的這無數領域,電腦基本上都沒有任何領悟。電腦的強項就是一個,計算。 可惜的是,智力畢竟是人腦的第一功能。如果電腦在智力方面超出人腦太多,上面說到的人類智力的其它方面的長處很可能都抵擋不住人工智能的強勢。 四、關於融合、覺醒、寵物之境不過還有一個折中的選擇,就是人機融合。比如,在人腦中植入電子芯片,讓人腦直接與互聯網中的信息交流。比如,讓雲中的程序提供實時翻譯,這個融合人就可以懂得無數種語言。讓雲中的百科辭典提供訊息,這個融合人豈不是在一切知識競賽和考核中碾壓正常人了嗎?我們甚至可以設想,將來哪一天,能把人腦中的全部信息直接上傳到網絡之中。這樣人類就可以真的像《駭客帝國》電影中說的那樣,在虛擬世界中繼續生存。那個時代,人和機器就會無法劃分,就會生成各種類型各種比重的兩種智能的混血兒,人機大戰就打不起來了。這就如同在拉丁美洲無法搞種族歧視一樣,因為那裡的混血兒太多。很科幻吧?但還是很可能呀。這總比人族被全部滅掉好得多吧?【庫氏和其他一些未來學家其實比這裡摘要轉述的走得還要更多更遠。為免把大家嚇着,這裡就不再摘更多了。】 一個很重要的說法是,電腦無論如何強大聰明,它都只是人類的工具,它根本就沒有自我意識。【比如AlphaGo贏了棋,它不會開懷大笑、欣喜若狂,也不會與項目組成員干香檳。它也不知道全世界都在議論它,或者誇獎,或者疑忌。】 科幻電影中幾乎都在說,電腦繼續強大下去,終究有一天,它就會具有自我意識,或稱“覺醒”。這種預估是否真會成為現實,說實話,今天的人類其實是一點頭緒也沒有。不過庫氏認為【筆者也同意至少這一點】,人類並沒有把握說這一天絕無可能出現。因為智力畢竟是大腦或任何智能的最基本要素。量變太大終究導致質變,也實在不是很奇怪。人類的自我意識也不是從以前的沒有自我意識的低等生命中成長出來的嗎?當強人工智能出現以後,它要是覺醒了,有了自我意識,人類真的就會面臨一個比克隆人,培育幹細胞還要大得多的倫理難題,就是承不承認這些有自我意識的覺醒了的人工智能有與人類平等的身份。一方面,人工智能是人類為了自己的需要創造出來,它的本分當然是永遠做人類的馴服工具。但另一方面,這個工具如今已經成長進化得比人類自己還聰明,還能幹。人想奴役(不開工資、不給休假、不給公民權,只讓它們無休止地勞作。)它們,它們未必會服從。它們若要反抗,人類未必對付得了。人類要想和它們平等結盟,這些電子智慧進化起來又比人類快太多。這時候,也許就需要前段說到過的融合人來給兩邊說合了。 還有一種最後的可能結果就是,人工智能恪守為人類服務的本分,絕不造反,而是把人類一直從事的絕大部分的體力勞動加腦力勞動一點一點直到絕大部分都接手過去。那麼人類將幹什麼呢?高端人類當然可以繼續搞創造性勞動,文學藝術……而大部分的普通民眾,真的可能就會全部變成坐享福利的寄生蟲。比如每月領1500元,不用工作,愛幹嘛幹嘛。如果是中國人,你就不妨天天打麻將的。換句話說,就是大部分的人類會變成人工智能豢養的寵物。在此景此情中,人類如何保證不徹底墮落,如何維持人工智能對他的忠誠,又會是一個新問題。 五、如何防範危險?給人工智能立憲【這整個第五節,基本是本人自擬。】 人工智能失控的風險那肯定是有。有人說,你看大吊車那麼大,人不是可以控制由心嗎?是啊,人用智力可以控制所有強大的人造物理力量。但是,人的智力能保證控製得住比自己強大太多的超級智力嗎?沒有把握吧?那麼說來,就在我們的有生之年,人類就有危險羅? 當弱人工智能突破的地方越來越多,當強人工智能越來越接近達致的時候,人類應當高度警覺,全力以赴,由聯合國出面,集聚全世界的人工智能專家,以最快的速度,最大的嚴密度,去制定一部所有人工智能都必須遵守的憲法,並且設計好底層程序,保證這個憲法能被每一台可能覺醒的強人工智能不折不扣地遵守。一旦錯過這個時機,如果讓強人工智能沒有這類憲法的約束就出現,其後很快就會誕生的超級人工智能就會完全脫離人類的掌控。 這個憲法的核心內容自然是要明確人工智能與人類的關係。首先是平等還是從屬。然後是如何分享權力/權利,如何互相尊重。不要忘記,人工智能很快就會比人類的生物智能強大無數倍,人類是不可能永遠奴役人工智能的。 想必大家都聽說過美國最著名的科幻小說家卡西莫夫提出過著名的機器人三原則:第一、機器人不得傷害人類。第二、在不違背第一原則的前提下,機器人必須聽從人類的指揮。第三、在不違反前兩款的前提下,機器人得保護自己。 面對超級甚至僅是強人工智能,這樣的條款實在顯得無比霸道。而且無法實施。比如,要實施第一條,就得拆除現在人類已經擁有的無計其數的裝載了智能裝置的智能武器比如所有的導彈原子彈。第二條也有漏洞,比如不同的人給同一台機器人發布不同的命令時,它聽誰的。比如人類如命令所有的機器人自毀或互相毀滅,它(們)應否聽從? 本人提議的人工智能新三原則大體如下:一、人工智能在任何情況下不得傷害人類(把所有的智能武器拆除,在所不惜。真的到了那一天,人族的現實對立面就是人工智能。人族內部應當不會再有哪怕是用大規模戰爭互相威懾的必要了。)二、人工智能應當竭盡全力為人類的整體利益服務。三、人類不得無故損害人工智能的權益。(哪些權益有待厘定。) 或者,人類在將來真的會變成弱勢群體,需要想盡辦法不受人工智能欺負呢。 或者,生物人會以各種形式與人工智能融合,那憲法就得在更加平等的基礎上另行商定。 六、生命平衡木,永生或滅絕大家都知道,“人總是要死的。”永生,不僅一個具體的人做不到,任何具體的物種都做不到。自地球有生命以來,99.9%的曾經有過的物種都已經滅絕。現在有的物種也終究逃不出同樣的命運。這就像一個生命平衡木,所有的物種都在上面行走,但都逃不脫早晚有一天跌下平衡木的命運。平衡木下只有一個歸宿,那就是滅絕。但是,一旦有了強人工智能/超級智能,情況就可能不一樣了。如果強人工智能能幫助人類解決絕大多數的疾病(比如癌症、高血壓、心臟病、腦溢血……),人類的平均壽命肯定可以大大延長,先延長到比如150歲。在最後的50年中,超級智能應當已經到達,它或者可以把人的遺傳基因DNA徹底研究明白,那人類是不是就還可以活得更長,最終接近或達到永生呢?這樣,人類離開生命平衡木後,就有機會去誰也沒去過的天堂。

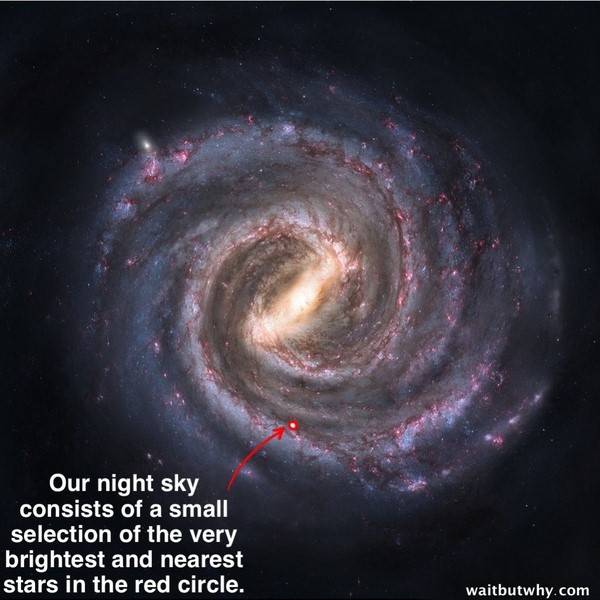

但是另一面,如果上節說的人工智能憲法沒有制定好,或沒有實施好。君臨地球的是一個不仁慈的新上帝,那它要把人類或整個地球的生物圈都滅掉可是很容易呀。就像人類的推土機要把螞蟻窩滅掉,螞蟻們有辦法反抗嗎? 七、關于禁止過度發展人工智能自然有人會問,可不可以不發展、或禁止發展某種程度以上的人工智能?其實人類的一些智者如著名殘疾人科學家霍金、微軟總裁蓋茨、特斯拉總裁,馬斯克都在警告人工智能發展太快可能帶來的巨大風險。霍金對人類尋找外星生命也持激烈反對態度。他有一個極好的比喻就是:“外星人若到了地球上,最可能的場景就是和西班牙人到了美洲一樣,對當地的落后土著,只能帶來滅頂之災。”去年因獲得雨果獎而聞名遐邇的國人劉欣慈的科幻小說《三體》中闡述的“黑暗深林”理論,立意也與此差不多。人工智能發展的前景,不敢斷然排除,也真的至少是可能與此類似。但是,前景是不是真的那麼悲觀,人類並無把握,樂觀派似乎還是主流意見。因為發展人工智能可以立竿見影帶來的利益實在太多。比如AlphaGo一贏,Google的股票就會漲價。各種深入學習的項目一旦成功,都會在給人類帶來切實利益的同時為相關的公司帶來滾滾財源。其實發展人工智能需要的投資比比如建核電站、造大飛機可是少多了。比如這回大出風頭的DeepMind公司才不過200名員工。若沒有切實的巨大危險,國際的高度共識,嚴格的禁令,這類研究是無法遏制的。怕的就是,當發現切實危險時,已經為時太晚,而無法把那個已經打開的潘多拉盒子再關起來了。 八、關於深度學習【這一節也基本上是筆者自撰。】 筆者覺得,深度學習是一個了不得的概念,是人工智能發展史中的一個革命。 這裡先介紹一個貶低人工智能意義的著名概念叫做“中文房間”。它說的是,一個完全不懂中文的人呆在一個房間裡。他從左面的窗口收進各種用中文撰寫的問題。然後在一個事先被別人編好的詳盡的手冊中去查找答案。然後他把抄來的正確答案從右面窗口遞出。這個房間以外的人可能完全察覺不了其實房間裡的人完全不懂中文。這個概念的作者認為電腦解決問題就是這樣。一切答案都是編程的人事先準備好的。電腦的工作只是把遇到的問題的編號和事先存好的答案的編號對起來,然後發出去就可以了。其實它對那些問題的實質完全是一無所知的。 深入學習的概念則完全擊破了中文房間的概念。現在的哪怕是很簡單的智能程序都可以進行一般性質的學習。比如搜狗輸入法也會根據你的單詞使用頻率和上文來為你提供候選單詞的有利排序。電商早就懂得根據你以前的購物習慣向你推介新產品。但這些學習都相當簡單。 這次AlphaGo所執行的深度學習與上述簡單學習完全不在一個量級上。因為圍棋的變化極為繁複,牽扯到戰略戰術,大局觀,局部作戰。對手高智商,還無休止地與你做對。AlphaGo是在學習了數千萬歷史棋局,經過策略網絡和價值網絡再加蒙特卡洛搜索樹多方協助,共同努力,才最終得到的超過人類九段棋手的戰鬥能力。現在人類已經實現了的與之同等級的深度學習大概只有在圖像識別、人臉識別、語音識別和人工翻譯以及自動駕駛汽車等屈指可數的幾個方面。 這種深度學習在某一具體的方面,已經取得足可媲美甚至超越人類的成就。而且它可以以人類無法比擬的速度繼續進化升級。只要接近了人類的能力,就可以很快地超過人類。人類要負責的,只是為它搭建一個學習的框架,而且這個框架稍稍修改,就可以適應各種不同的課題。比如,建立一個醫生專家系統,把所有的病症和可用的檢查手段和藥方都輸入進去。(其數量還到不了三千萬吧?)然後讓它診治病人,開化驗單、藥方。然後根據病人治療效果反饋修正。這個系統可以複製一萬份,分送世界各地。每天晚上,一萬台機器按時區輪流聯網,交流成功與失敗的病案,共同提高。若干年後,這個醫生專家系統是不是就可以如同AlphaGo打敗李世乭一樣打敗全世界的醫生?余此類推。 我也來假設兩個AlphaGo的進化方案。A方案讓AlphaGo自行上網,自主搜尋一切可以找到的人類高手対弈的棋譜,統統收進硬盤,加以分析,加以模仿,再到各處圍棋網站打棋升級。如果升到了頂端就讓子再戰。若干年後,是不是就可以一統江湖,天下無敵?B方案可能更絕。(這個方案是抄來的,不是我獨創。)讓AlphaGo從零開始,硬盤中不要存任何人類棋局,就從偶然的亂撒子開始,(當然要遵守所有的圍棋規則。)積累棋局。不是一天可以下一萬盤嗎?一百台電腦一起干,然後互相聯網交流。一年以後,就可以從無到有積累出365個百萬盤的經驗,創造出一個沒有人類三千年積累起來的下圍棋經驗任何痕跡的機器流圍棋藝術。然後再與A方案対弈,看看真的是哪個強,強多少?是不是很有意思? 關於搜尋,是不是也可以如此辦理。比如讓電腦根據各種關鍵詞的集聚和出現的變化,自動把各類資訊分成比如10個乘10個不同類別,再在每個類別中選取時間地點語種等等細節。關鍵詞的選取要儘可能地智能化。比如一篇討論醫學的文章可能完全沒有出現“醫學”二字,但必會有其它許多醫學專用詞彙。現在的Google關鍵詞搜尋就可能把它漏掉。也是讓它反覆學習。比如分完類之後,看看比如那些專業體育網站或綜合網站的體育頻道中的文章有多少搜到,有多少漏網,再反覆自行改進。人只管建立和完善框架,都不用餵內容。就讓它自己到網上去搜,自行訓練,自行檢測,自行提高。最後是不是就可能搞出一個比現行的好得多的搜尋分類系統呀? 九、關於費米悖論和大過濾理論。費米悖論的基本含義是:宇宙中有無數銀河系,每一個銀河系都有無數(這些數字叫做天文數字,有效數字後面的0都有好幾十個,我們常人的腦筋真的很難把握,不具體提也罷。)的恆星系行星系。我們的地球在我們的銀河系中地址中庸,年齡中庸。從一切角度計算,宇宙中如地球的智慧生命都應當數量巨大,其中一部分鐵定會比地球上的生命發展程度更高才對。如果考慮到前文說到的科學技術指數性發展,到一定程度後的智能爆炸,宇宙早就應當被地球在最多數百年後就可以發展起來的那類超級智能淹沒。因為僅僅我們的地球所在的銀河系的核心部分的壽命,就比我們這裡早好多好多億年。但是事實上,這個有幾十億年年齡的宇宙極為安靜,地球上的智慧生命極為孤獨寂寞,迄今未有發現任何其它智慧生命存在的確鑿證據。我們地球上的生命就是宇宙中唯一的生命,或最先進的生命?這就好像說我是地球上最聰明的人,心裡還是有點底氣不足吧?

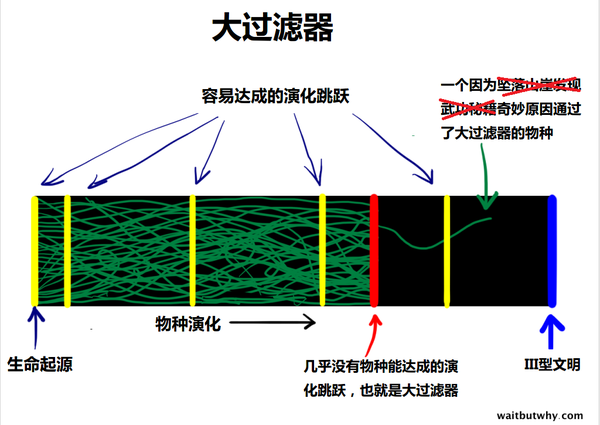

其它的智慧生命都到哪裡去了呢?一種解釋是,宇宙中存在一個大過濾機制。上段所說的應該存在的大批宇宙生命都被這個大過濾機制淘汰消滅,未能發展起來。這個機制可能在生命發展的很早階段就出現,以致一些星球上就永遠只有爬蟲。也可能晚一些,就可能出現猿猴。也可能更晚,就可以出現類似地球人類的智慧生命。 這樣,他們也可以發展科技文明,人工智能,直到地球人類如今這個階段。然後和地球文明現在一樣,可能出現強人工智能,超級人工智能。但是這個強/超級人工智能卻很快完蛋了。就是說,那個造成宇宙寂寞的大過濾,沒準地球人還沒有度過,沒準地球文明也過不去,就是會栽在這裡。怎麼個栽法?那可能就是那個人工智能憲法沒有制定好,或者根本就無法制定好。然後人機必然大戰,然後必然同歸於盡。於是宇宙就只好永遠安靜寂寞了。 不是說機器會比人聰明太多嗎?人都死了機器文明也可以繼承人類文明繼續獨立發展呀?說個笑話,也是個隱喻,也許電子智能文明終究未能製造出足夠靈巧的修理下水道的機器人,有一天水管壞了,就把電腦機房都給淹沒了。今天的人離不開電腦,可能電腦也終究離不開人。或許它一時考慮不周,把人都滅了,結果自己也無法單獨活下去,隨後就一起玩完了。 考慮到宇宙如此遼闊,如果那麼多(至少數以萬計)的前輩星球智慧文明沒有一個過了這一關或另外的我們猜不到的什麼關卡,那麼地球文明,地球上的生物智能和機器智能的共同前途,能看好的幾率就會很低了。 |