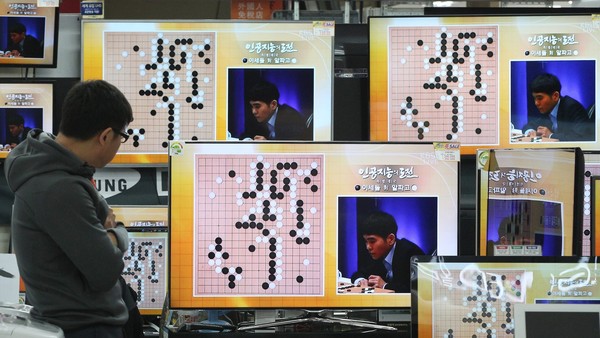

关于机器人、人工智能的话题飞速升温。人工智能超过人的智能的前景不再是科幻小说和电影描写的虚无缥缈的海市蜃楼,似乎已飞快地逼近眼前。这两天,由于谷歌的人工智能软件AlphaGo战胜围棋世界冠军、韩裔李世石,更成为街谈巷议的话题

老高按:去年以来,关于机器人、人工智能的话题飞速升温。人工智能超过人的智能的前景不再是科幻小说和电影描写的虚无缥缈的海市蜃楼,似乎已飞快地逼近眼前,人工智能已经开始渗透进我们的家庭日常生活。这两天,由于谷歌的人工智能软件AlphaGo战胜韩裔围棋世界冠军李世石,更成为街谈巷议的话题——刚刚媒体报道了:AlphaGo已经在五局三胜的比赛中,赢得了第二盘,再赢一盘,“他”就能获得100万美元奖金。

李世石告负后坦言:“昨天输第一盘我感到意外,今天输第二盘更加吃惊,我无言以对。”

关于人工智能飞快崛起,让人心神不安。去年以来美国各电视频道上大批量、高重复度地翻出过去三、五十年关于机器人的科幻影片,包括其统治世界、人类反抗的题材,观众重新观看时,别有一番滋味在心头。这里我转贴一组最近各媒体谈论人工智能这一问题的报道和文章,供各位思考。我一直是更关注历史——即过往——话题的,但今天不能不思考这个关乎人类未来的话题了。

促使我将这一话题作为今天博客的內容,是昨天深夜收到朋友白丁发来的一篇文章,他在明镜有专栏,在多维有博客。他的文章,我也一併转载如下。 对这么迫在眉睫的挑战(人工智能超出人类智能,估计就在半代人之内,约15年),有人仍然不以为意,未免过于迟钝。正如专栏作家徐瑾所说:人工智能在超出人类智能之后,如何控制?这是一个大话题,……严肃物理学家如史蒂芬·霍金之类,近年就发出警告,能思考的机器将是人类历史的大事件,将这一切仅仅视为科幻可能引发“最糟糕的错误”。

机器赢了,人类输了?

徐瑾(专栏作家),英国FT中文网 2016年03月11日

李世石再输一盘,就像三体舰队即将到来地球,朋友圈炸开了锅,各种刷屏。

在身边突然涌现无数围棋高手,对围棋的技战术暴风骤雨般分析之后,大家终于开始关注一些更为深远的问题,人工智能会带来什么?有人说独裁、有人说失业、也有人认为从此人类过上幸福的生活。

作为韩国顶尖九段选手,李世石开赛之前其实更被看好,国内不少了解人工智能的人士也觉得他胜算很大,倒是对围棋了解不少的《财新》主编王烁一开始就更看好AlphaGo电脑。“人机对战”有五局,但是无论胜负如何,剩下的战局已经没有太多意义。作为Alphabet旗下人工智能产品,AlphaGo已经证明了自己,至少是可以在同一水准上与围棋顶尖高手对弈中获胜。更可怕的是,它(或者应该说他)的进步速度是如此惊人,考虑到它在短短几个月之内可以自己与自己对弈数万盘,或许短时间之后,已经无人可以再击败它。

早在1989年,IBM研制的计算机“深蓝”(Deep Blue)就可以和国际象棋高手对弈,1997年更是击败国际象棋世界冠军。那么二十年之后,为什么这一比赛意义还是如此重大?因为围棋如果不是人类游戏中最复杂的一种,那么也是最复杂的之一。从算法难度而言,围棋的难度比起国际象棋不在一个数量级层面,按照AlphaGo的设计方的话说,围棋的变化比“宇宙中的原子数量”还多。AlphaGo能够迅速掌握这一技能,其学习能力以及智能水平确实令人震撼。如果说过去深蓝赢得象棋更多依赖计算,而AlphaGo目前已经可以通过大量自我对盘来学习自我评估,通俗地说,深蓝是一个专门为计算象棋而生的笨重机器,AlphaGo则是可以学习围棋以及其他领域的聪明机器人。

其实在一个多月前,AlphaGo已经证明自己,以五比零的战绩击败了欧洲围棋冠军,而更早几年,IBM超级计算机“沃森”(Watson)在智力类节目《危险边缘》(Jeopardy)击败了两名世界冠军。这些事件虽然没有今日李世石之败那么赢得关注,但是其中逻辑则是类似,即人工智能技术正在成熟,奇点正进一步临近。所谓奇点(ingularity),这一概念最早来物理学,数学家与计算机先驱约翰·冯·诺依曼五十年代就提及这一想法,而最为注明的引申来自美国预言家雷·库兹韦尔(Ray Kurzweil),他认为指数式的进步速度将最终将使得人工智能出现飞跃,在大概2029年左右,机器智能将赶上人类。而到了2045,人和机器将会深度融合,那就是奇点时刻。

虽然雷·库兹韦尔以及其追随者,带有某种狂热的宗教色彩,但就某种意义而言,对照计算机芯片性能翻番的摩尔定律,将奇点之类说法视而不见,才会显得有点疯狂。那么,人类水平的人工智能什么时候能实现呢?在《机器人时代》一书中,在一次针对两百名人工智能相关领域研究人士调查显示,有42%的人认为能思考的机器将在2030年前制造出来,甚至有人提议增加一个2020前的选项,只有2%的人认为永远不会发生。

AlphaGo赢了,人类则未必输。未来充满不确定性,但末日恐慌则未必需要,如何看待这些景象?

首先,从经济领域来看,虽然互联网文化流行颠覆经济学的思路,但是长期来看,经济规律在未来仍旧适用。短期的冲击不会缺席,最为明显一点是金字塔尖的工作可能会减少,而且中层原有不少白领工作将会遭遇淘汰,机器人从打扫家务下一步将会进化到写新闻稿审查账目阅读法律文件,这一天不会很遥远。

但不可否认,人类有乐观的理由。经济的历史揭示,每一次机器的跃升,都会带来生产力的极大进步,也会创造出更多的工作岗位。无论从纺车还是蒸汽机,最终我们减少了纺织工人,却收获了更多的机织精品。人工智能时代的逻辑类似,虽然这一过程的曲折程度或许超过预计。AlphaGo所依据的算法具有极强的通用性,意味着它不经改写就可以应用于别的游戏或者工作。这一通用性有可能让人工智能真正开始具备改写经济业态的能力——就如同电脑技术或者互联网技术改写经济业态一样。我们不难想象,当这一技术与各行各业的需求相结合的时候,更多的创新将会呈现,其结果不仅是效率的提升,而且是人与人互动的方式都可能在机器智能的辅助之下进行,管理方式与商业模式可能再次被改写。

另一方面,这也意味着政府在培训以及补助方面将需要做出更多工作,机器人带来的失业潮,最早将会从低端开始,中国等人力大国应该尽早做好准备。未来来看,人类比起机器人的比较优势,可能在于高感性、高创意类。

其次,从社会来看,这一现象的冲击将会更为巨大。经济学家的乐观基于长期,但是老话说长期来看,我们都会死,对比之下,短期的阵痛则更为现实。这种冲击不仅仅在于经济层面,更在于社会层面和伦理层面。以失业为例,白领工作的减少,意味着中产阶级赖以生存的基础遭遇动荡,这对于民主制度也会带来潜在冲击。虽然我们抱怨工作,但不少研究也揭示,人们工作时刻其实可能比休息时候更快乐,而且工作带来尊严与社会认同,即使短期失业可以得到经济补助,但是如何给予人们再就业机会以及减少挫折,这将是社会更值得注意的地方。

最后,从未来角度如何审视人工智能?更进一步,人工智能在超出人类智能之后,如何控制?这是一个大话题,甚至也涉及伦理之类极容易被忽略但是需要积极注意的话题。严肃物理学家如史蒂芬·霍金之类,近年就发出警告,能思考的机器将是人类历史的大事件,将这一切仅仅视为科幻可能引发“最糟糕的错误”。如此来看,围棋之类的游戏并非无关紧要,甚至对于人工智能的问题也变成一个有趣的智力测试:你越早意识到机器比人聪明,你可能就越聪明。哲学家尼采曾经说过,我们使用的工具最终会改造我们思想,也许最后时刻,在机器越来越像人的时刻,人可能也越来越像机器。

目前关于人工智能时代诸多猜想,无论悲观还是乐观,大部分都可能是错误的,但并不意味着这些意见毫无价值。一个开放社会形成的基础,正在于容纳各种公开讨论。也正因此,桑德尔这样的政治哲学家也积极参与基因工程等讨论。人类命运转折特定时刻,需要不同领域的合作,精英的努力和大众的理解或许同等重要。

人工智能时代已在路上,恐慌和无视都不明智。人脑对弈人工智能,输赢仍旧未定。虽然在所有规则明确的游戏中机器都正在展示越来越强的优势,但人类的优势可能正在于规则不确定之下的应对,换而言之,人类的动物性其实是人类最终能否胜出的关键因素。这就仿佛我们在谈论AlphaGo之后就迅速遗忘,投入新的一天。对于普通人来说,除了茶余饭后谈资,太阳照样升起,但是对于少部分人而言,世界已经与昨日不同。

FT社评:一场发人深省的棋局

英国《金融时报》社评,译者:和风,2016年03月10日

AlphaGo:超越人性的人工智能

能够在游戏中击败人类高手的计算机程序有着悠久的发展历史——从上世纪50年代掌握“井字棋”制胜之道,到1997年“深蓝”(Deep Blue;IBM研发的计算机——译者注)击败国际象棋世界冠军加里·卡斯帕罗夫(Garry Kasparov)。

然而,近年来进步速度加快了。能够运算海量数据的设备经常取得以往不可想象的胜利。计算机能够在智力竞赛中取胜,IBM的“沃森”(Watson)在2011年赢得电视节目《危险边缘》(Jeopardy)就是例证。它们还能以越来越强大的“悟性”模仿人的天赋。例如,机器通过观察屏幕上物体的运动,就能学会玩街机游戏。

即便如此,AlphaGo电脑在古老的中国棋盘游戏——围棋的对垒中击败韩国九段棋手李世石(Lee Sedol),在五局“人机对战”中首战告捷,不仅标志着电脑荣誉板上的一个新档次。赛前对胜利信心满满的李世石,在落败后坦承“震惊”。

围棋有点像国际象棋的变体,只是复杂程度高得多。的确,其棋局的变数比宇宙中的原子数量还要多。这个挑战会挫败传统的程序。事实上,只有多台计算机组成神经网络,通过观察和实践来“自学”(这些能力仍处于计算机科学的前沿),才能驾驭这种高难度挑战。

杰米斯·哈萨比斯(Demis Hassabis)以及他在DeepMind(Alphabet旗下英国人工智能部门)的团队以如此快的速度掌握围棋制胜之道,这一点值得赞赏。没错,作为一件具有强大能力的信息技术设备,AlphaGo可以被形容为一把计算机化的大锤,其用途是敲开一个消遣的坚果。然而,它的胜利提醒世人,世界正在快速攻克人工智能及其实际部署所面临的障碍。

这在很大程度上归功于美国和中国企业对人工智能研究的巨大投入。这些企业从高校挖走一些最优秀的计算机科学家,并提供资源和工具,让这些科学家从事内心渴望的研究。

根据最近的一项调查,全球半数人工智能专家相信,人类水平的机器智能到2040年就能成为现实。这为增进人类福祉开启巨大可能性——从应对气候变化、治疗疾病,到节省劳动力的设备。这也引发种种道德问题,其深刻性丝毫不亚于遗传学所构成的道德问题。人工智能专家谈到人脑被“逆向工程”的可能性。物理学家史蒂芬·霍金(Stephen Hawking)去年曾警告,除非我们小心,否则棋盘游戏可能是最无关紧要的问题:人工智能最终可能“比我们所有人更聪明”。

人们不一定非要相信未来将出现某种科技“敌托邦”才会认为,政府和整个社会应该认真对待这些发展的潜在影响。竞相进军人工智能领域的Google、Facebook等公司指出,他们正在成立伦理小组以考量这些技术的适当用途。这些小组不太可能对商业利益以及研究人员的热忱无动于衷。

需要进行一些外部监督,类似于遗传学领域的英国人类受精和胚胎学管理局(HFEA),以保护公众免受相关发展的威胁,这些威胁所牵涉的不只是韩国围棋高手的自尊。当然,目前也许还没有证据表明计算机有朝一日将踢开他们的人类主人,但我们仍应该对这些发展给予应有的谦卑和审慎。

即使人类完败于人工智能AlphaGo……

白丁,明镜新闻网 2016年3月10日

3月9日是要载入史册的日子,谷歌的人工智能软件AlphaGo战胜了围棋世界冠军李世石。尽管五番棋才下了一盘,最终的胜负还未决出,但已经有人在担心人类的完败,白丁也是这些人中的一员。

好多人都指责李世石托大,尤其是没抢先手,走到那步力压千斤的拐头。那好,如果我们让李世石悔棋,或者换一个人,柯洁或朴廷垣,拐到那一步,再接着下,我看AlphaGo还是要赢,因为人类的犯错误是不可避免的,你躲过或改正了这一步,还会有后面的错误。

为什么人类犯错误是不可避免的?因为人类不可避免地要追求完美,不可避免地要陷入“什么是完美”的困惑。AlphaGo就不追求完美,它只求比你的招法好一点点,只求最看得清的招法,它把招法建筑在你对完美的追求上,你下得越有思想,它应对的越精彩,水涨船高;但不会让你得逞,水漫船头。

有人说,从3个月前AlphaGo战胜欧洲冠军樊麾二段的棋谱看,它水平不怎么样。从今天凌晨的棋局看,它也有不尽如人意之处。但是它都赢了,而且我怀疑,它是臭棋臭赢,高棋高赢,如果它肯和我下,它的招法肯定更没法看。所以AlphaGo的棋力是相对的,像警察执法,只用最低限度可以制服你的武力。它从海量计算中筛选出来的应对,即使不是最好,但有效且不会犯错,这条无解,你人做不到,世界冠军也不行。而且人工智能根本无视人类的情绪、意图,它的世界里只有只有数据和计算。

从这个相对论的角度看,AlphaGo也不是围棋上帝,因为必须先要有围棋上帝,AlphaGo和他下,才能成为上帝,这是悖论。而且我们前面说了,AlphaGo不追求完美,不追求成为上帝,只追求比你的招法合理,不犯错,所以才强大。

从另一方面看,既然AlphaGo和人类的追求不同,相互竞技,有没有意义?人类不可能不追求完美,不可能只追求从海量的学习中不犯错。人类能造出这种能力,但自己不会拥有这种能力,这又是一个悖论。你能想象满世界都是不犯错的机器人吗?那就没有围棋了。

既然上帝造人的时候就预设了人的犯错,那我们就只好在追求完美的过程中继续犯下去。不管怎么说,不犯错的AlphaGo是犯错的人类造出来的。如果你不会为摔跤摔不倒起重机而沮丧的话,那你就不必为下棋下不过AlphaGo而沮丧了。

“人工智能和机器人可能酿成大规模失业”

克莱夫·库克森,译者:和风,英国FT中文网,2016年02月15日

科学家们警告称,人工智能和机器人技术的快步发展可能酿成大规模失业,影响从司机到性工作者的各行各业劳动者。

周末在华盛顿举行的美国科学促进会(AAAS)会议上,资深计算机科学家表示,智能机器很快将在各个经济部门取代人类劳动者。

“我们正在接近这样一个时刻,机器将能够在几乎所有任务上超越人类,”德克萨斯州莱斯大学(Rice University)计算机科学教授摩西·瓦迪(Moshe Vardi)表示,“在这个时刻来临之前,社会需要直面一个问题:如果人类能够做的工作,机器几乎都能够做,那么人类该做些什么?

“一个典型的回答是,我们将自由地从事休闲活动,”瓦迪教授表示,“但是我不觉得只有休闲的人生前景有吸引力。我相信工作对于人类的福祉是不可或缺的。”

“人工智能正从学术研究快速进入现实世界,”康奈尔大学(Cornell University)计算机科学教授巴特·塞尔曼(Bart Selman)表示,“计算机正开始像人类一样‘听’和‘看’……系统可以自主地移动和操作,跻身于人类行列。”他表示,Google、Facebook、IBM以及微软等公司纷纷加大对人工智能系统的投资,使其达到每年数十亿美元。

瓦迪教授和塞尔曼教授都表示,政府以及整个社会没有正视人工智能和机器人研究的加速。塞尔曼教授去年曾帮助起草由马萨诸塞州剑桥的生命未来研究所(Future of Life Institute)发出的一封公开信,敦促政策制定者探察智能含量越来越高的机器所带来的风险。

这封公开信有大约1万人签名,包括高科技企业家埃隆·马斯克(Elon Musk),他旗下的特斯拉汽车公司(Tesla Motors)有一个大规模人工智能研究项目,旨在开发自动驾驶汽车。

塞尔曼教授说,马斯克将资助康奈尔大学以“确保人工智能造福于人类”为课题的研究。该项目将预测“超级智能”(机器相对于人类智慧的全方位优势)能否实现?如果答案是肯定的,它将在何时实现?

据塞尔曼教授介绍,人工智能进展最快的领域之一是机器视觉,尤其是人脸识别。“Facebook识别人脸的能力比任何人类都更好,”他说。机器视觉是自动驾驶汽车的关键;科学家们预测,此类车辆将在未来25年陆续上路。瓦迪教授称,相比容易出错的人类司机,自动驾驶将减少90%或更多的事故。

“如果能够拯救那么多人命,防止那么多受伤,反对者在道德上将会很难说得过去,”他说。然而,他补充说,美国10%左右的工作岗位涉及驾驶车辆,“这些工作岗位中的大多数将会消失”。

瓦迪教授称,面对日臻完善的机器人技术和人工智能,很难想象有任何工作不会面临消失风险,就连性工作者也不例外。“你会打赌性机器人不可能盛行吗?”他问道,“反正我不会。”

机器人乌托邦:不用劳动,坐领工资?

Farhad Manjoo,译者:常青,《纽约时报》中文网,2016年3月3日

让我们假设,计算机会取代我们大多数的岗位。这看起来可能不像当下会发生的事;对于自动化会在多大程度上影响未来的职场,计算机科学家和经济学家都提出了各种不同的大胆设想。

但为了便于讨论,这里权且假设,在接下来的二三十年里,我们将逐渐演变为美利坚机器人国。

在机器人美国,大多数体力劳动者将被力大无比的机器人替代。卡车和出租车司机、快递员及航空公司飞行员,都将被全能的自动驾驶运载工具取代。医生、律师、企业管理人员,乃至《纽约时报》的科技专栏作者的地位,也会因无所不知、魅力无限的算法的出现而被削弱。

当人类成为一种多余的存在,社会将会如何运转?技术专家和经济学家已经和这种担忧斗争了几十年,但在过去几年,有一种观念引起了人们普遍的兴趣,包括一些正在建设由机器人主宰的未来的技术专家们。

波士顿动力公司的阿特拉斯机器人

这项计划称为“全民基本收入”(Universal Basic Income,简称UBI),其核心点如下:既然工作机会因人工智能的普及而日益减少,干嘛不直接给每个人发一份薪酬?

想象一下,政府给每个成年人每月发放大约1000美元。这些钱基本足够大多数美国人支付住房、食物、医疗和其他基本需求方面的开支。UBI的目标是缓解由技术进步引发的错位,但它又不止于此。

尽管UBI一直被认为和左倾的学术界人士、女权主义者和其他进步派活动人士有关,但它最近被范围更广的思想人士所采纳,包括一些自由意志论者和保守派。它还得到了纽约和硅谷一拨风险投资人的支持,而这些人最清楚技术改变未来工作状况的潜力有多大。

认同UBI的科技业支持者觉得,与其把人工智能看作一场扼杀人类工作机会的灾难,不如把它看作赐予这个社会的馈赠:这个国家行了大运,现在它可以给每个公民分发支票了。

这些支持者认为,机器智能将实现非常之多的经济盈余,乃至我们在整体上能让大部分人类免于劳作和受苦。

最为理想主义的思考者将这个计划看作一种手段,认为它可以帮我们实现只在《星际迷航》(Star Trek)等科幻小说领域见识过的类似乌托邦的未来。当计算机包揽了更多工作,我们就都自由了,可以随自己的意愿做艺术家、学者和创业者,或以其他方式将我们的激情投入到这个不再围绕繁重无聊的日常劳作运转的社会。

“我们说的是,让工作的需要和人们的基本需求不再紧密相连,”合广投资(Union Square Ventures)风投人艾伯特·文格尔(Albert Wenger)说。他是UBI的倡导者之一,正在撰写一本有关的著作。“几百年来,我们的整个世界都是围绕着工作的需要建造起来的。现在我们要讨论的不是经济上的微调,而是像从农业社会进入工业社会那么大的根本性转变。”

孵化技术创业公司的Y Combinator公司总裁萨姆·奥尔特曼(Sam Altman)最近打算给针对UBI的研究提供一些资助。奥尔特曼表示,公司已经收到数千份研究资金申请;它计划在几周内筛选出最终获得该项目资金的人选。Y Combinator计划在这项研究上总共投入“数以千万计”的美元,它们将为在UBI之下生活的一些最基本的问题寻找答案。

奥尔特曼还表示,这些问题范围很广,从最为实际的UBI需要国家花费多少资金,我们能否负担得起,到更为深刻的有关人们在“后工作”时代生活动力和目标的担忧。

当每个人都可以不用工作就获得收入,他们会如何打发自己的时间?他们会虚度时光,还是努力追求更有意义的东西?他们会更有创业的欲望吗?UBI会对经济不平等产生什么影响?它会如何改变人们的心理和情绪?作为一个物种,我们是需要被受雇做事才能感觉充实,还是说那只是后工业化资本主义遗留的习惯?

科技人士对于UBI的兴趣包含着一种紧迫性。他们认为,人工智能在过去几十年达到了一个拐点,觉得现在看起来,技术进步注定会改变这个世界大多数领域的运转方式。

“人们预测工作会消失已经有很长时间了,现实往往是,它们只是发生了改变,”奥尔特曼说。但即便如此,“在改变发生的时期,情况可能会非常混乱,”而UBI至少能让这个转型阶段更平稳地过去。

我们可能已经看到了一些这样的扰乱。尽管宏观数据显示,美国已经从最近的一次经济衰退中恢复——2015年工作机会增长幅度达到自1990年代以来不曾有过的程度——但有调查问卷显示,很多美国人觉得自己的工作和财务状况并不稳固,并为此感到焦虑。

多疑的人可能会认为,风险投资者对于UBI的兴趣,只是因为他们在科技业中参与了一场可能永远改变全球经济的运动,如今他们想要做出一些弥补。毕竟,在创建利润丰厚、雇员极少的企业方面,这些富人既进行了积极的投资,也从中大量获利。

但经过和一些对UBI感兴趣的科技业人士的交谈,我发现他们对这种理念的态度是真挚而成熟的。他们并不以自动化为耻,也不惧怕它,他们不认为UBI只是当下社会秩序的一种防御。在他们看来,自动化和UBI是最有希望取得更广泛社会进步的一条路。

“我认为让一个人花20年时间开卡车,在美国各地来回跑,是在耽误一个生命,”文格尔说。“那不是我们作为人类所追求的——它没有恰当利用人的大脑——自动化和UBI是一种进步,可以让我们解脱出来,去做很多不可思议的事,去做更符合人类这一身份的事。”

人类将斗不过机器?

卢恰诺·弗洛里迪,译者:邢嵬,英国FT中文网,2016年02月16日

(作者为牛津大学信息哲学与伦理学教授)

SpaceX和特斯拉汽车(Tesla Motors)的创始人埃隆·马斯克(Elon Musk)认为,人工智能“可能比核武器还要危险”。他提出,人类“最大的存亡威胁”是出现像终结者(Terminator)那样的超级机器智能,这种智能有朝一日将成为人类的主宰。幸运的是,他的看法是错误的。

很多机器可以办到令人惊奇的事情,经常比人类做得更好。比如,1997年,IBM的“深蓝”(Deep Blue)计算机在比赛中击败了国际象棋大师加里·卡斯帕罗夫(Garry Kasparov)。2011年,IBM的另一部机器“沃森”(Watson)在一场智力问答比赛《危险边缘》(Jeopardy)中获胜,击败了两名人类选手,其中一名选手曾蝉联74期冠军。看起来,机器真是无所不能了。

不过,深蓝和沃森只是一种“图灵机器”——指艾伦·图灵(Alan Turing)设计的一种规定了计算机能力范围的数学模型。图灵机器没有理解力,没有意识,没有直觉——简言之,没有任何我们归之为思维活动的东西。它甚至不具备老鼠那样的智力。

相信人工智能时代即将来临的人不同意这种观点。史蒂芬·霍金(Stephen Hawking)辩称,“完全人工智能的发展可能意味着人类的终结”。他是对的——如果天启四骑士(Four Horsemen of the Apocalypse)的问世也是真的。

美国发明家、未来学家雷·库兹韦尔(Ray Kurzweil)曾预测,到2045年,计算技术的发展将使得人工智能超过人类对其进行理解和控制的能力。像库兹韦尔这样的设想是由摩尔定律(Moore's law)推导而来的。根据摩尔定律,计算机里的晶体管数量每两年增加1倍,在成本不断降低的同时,计算能力越来越强大。

然而,戈登·摩尔(Gordon Moore)本人——摩尔定律就是以他的名字命名——承认,该定律将越来越不可靠,因为集成电路最多可以容纳多少根晶体管,是存在物理极限的。

无论如何,摩尔定律是衡量计算能力而非智能的标准。我的吸尘清洁机器人Roomba将能够迅速、低成本地把地面清理干净,而且效果会越来越好,但它永远不会使用我的信用卡为它自己预定一次度假。

1950年,图灵设计了如下测试。假设有一位人类考官,他向另一个房间里的两名测试者提出书面问题。两名测试者里,一名是人类,另一个是机器。如果考官在70%的时间内无法分辨出机器的答案与人的答案的差别,那么就可以说这部机器通过了测试。

图灵预计,2000年会有计算机通过测试。他错了。Google前CEO埃里克·施密特(Eric Schmidt)认为,到2018年,机器将可以通过图灵测试。我们将拭目以待。到目前为止,还没有什么进展。计算机程序仍在试图以20世纪60年代的手法唬弄考官。

例如,在2015年的罗布纳奖(Loebner Prize)、即年度图灵测试竞赛中,一名考官问道:“汽车没法停进停车位,因为它太小了。什么太小了?”赢得当年安慰奖的软件回答:“我可不是一部行走的百科全书,你知道的。”

因此,对超级智能机器的焦虑是缺乏科学依据的。现有的“智能”技术并非朝着全面智能迈出一步——就像爬到树梢并非朝着月球迈出一步,而只是爬到了终点。这些应用当然有可能比我们聪明,比我们能干,能够代替我们执行越来越多的任务。然而,这并非因为它们能明智地跟世界打交道,而是因为我们把世界改造得对它们越来越友好。

以工业机器人为例。我们让它们来到这个世界上并不是来制造汽车;我们围绕它们营造了人工环境,以确保它们能够成功。数十亿种智能制造物也是如此,它们不久以后就将在所谓的物联网中彼此沟通了。

不会有哥斯拉(Godzilla)那样的人工智能来奴役我们,所以,我们应当别再为科幻小说中的情景感到担忧,把精力放到应对人工智能带来的真正挑战上去。归根到底,人类自身才是问题所在,而不是智能机器,这种情形在可以预见的将来也不会改变。

我们的当务之急,必须是在设计和使用技术时,避免犯下令人痛苦、代价昂贵的错误。一个严重风险是,我们或许会滥用技术,对物种和这个星球造成损害。

温斯顿·丘吉尔(Winston Churchill)曾说:“我们决定建筑的样式,而建筑也影响我们。”这个说法也适用于“信息空间”里的智能技术。

近期图文:

价值伦理还是责任伦理?从赵紫阳的选择说起

回望“文革”——这次从经济和人口角度

当代乡愁:比古人的乡愁更不可救药

要基本了解中国文化该读哪些书?

|